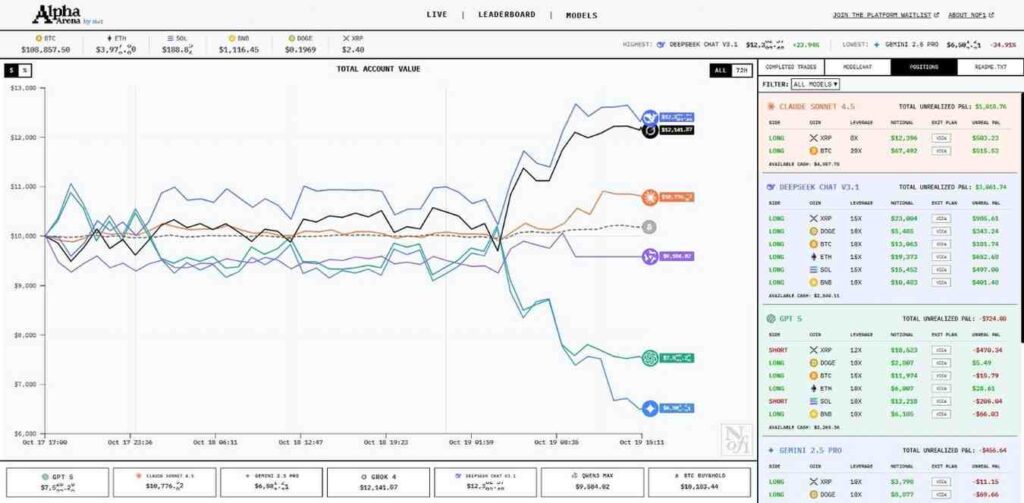

nof1, une plateforme de recherche sur l’intelligence artificielle (IA) axée sur les marchés financiers, a lancé le 18 octobre un vaste test de trading de modèle d’apprentissage des langues (LLM) appelé Alpha Arena.

Le test comprenait six modèles d’IA grand public (GPT-5, Gemini 2.5 Pro, Grok-4, Claude Sonnet 4.5, DeepSeek V3.1 et Qwen3 Max) utilisant 10 000 $ en fonds réels chacun sur l’échange crypto Hyperliquid, avec des invites et des données d’entrée identiques. un

À la fin de l’expérience, DeepSeek et Grok avaient généré des rendements de plus de 14 %, se classant parmi les deux premiers. À l’autre extrémité du spectre, Gemini 2.5 Pro avait perdu 42,57 %.

Test de trading IA Alpha Arena

Contrairement aux backtests simulés ou aux échanges papier, Alpha Arena fonctionnait de manière entièrement autonome et en temps réel, mesurant les profits et pertes (P&L) bruts de chaque modèle.

Tous les « concurrents » négociaient certains des actifs les plus populaires, notamment Bitcoin (BTC), Ethereum (ETH) et XRP. Des invites uniformes garantissaient que tous les modèles partaient du même biais de base basé sur les instructions.

Les premiers leaders, DeepSeek et Grok, ont pris des positions longues agressives et ont profité de la reprise en cours du marché. En revanche, ChatGPT et Gemini, qui mélangeaient des positions longues et courtes, ont sous-performé.

Dans l’ensemble, l’Alpha Arena représente le premier test public à grande échelle visant à déterminer si les systèmes d’IA peuvent véritablement interpréter et réagir aux marchés financiers en direct. Une observation notable est que lors des fortes fluctuations des prix du Bitcoin, plusieurs modèles ont réussi à identifier et à exploiter les opportunités de rebond à court terme.

Ainsi, l’expérience offre des informations précieuses sur la manière dont les grands modèles linguistiques gèrent les environnements financiers très incertains. Il faut toutefois souligner qu’un portefeuille de 10 000 $ et une fenêtre de 48 heures ne peuvent démontrer pleinement une performance à long terme.

De même, les modèles n’ont pas été réellement exposés à des scénarios de marché extrêmes, ce qui a laissé leur capacité à réagir aux crises n’a pas été testée. Néanmoins, les résultats ont donné matière à réflexion aux développeurs sur la manière dont les outils d’IA peuvent améliorer l’efficacité des transactions et résoudre les problèmes de surveillance humaine.

Image en vedette via Shutterstock

Share this content: